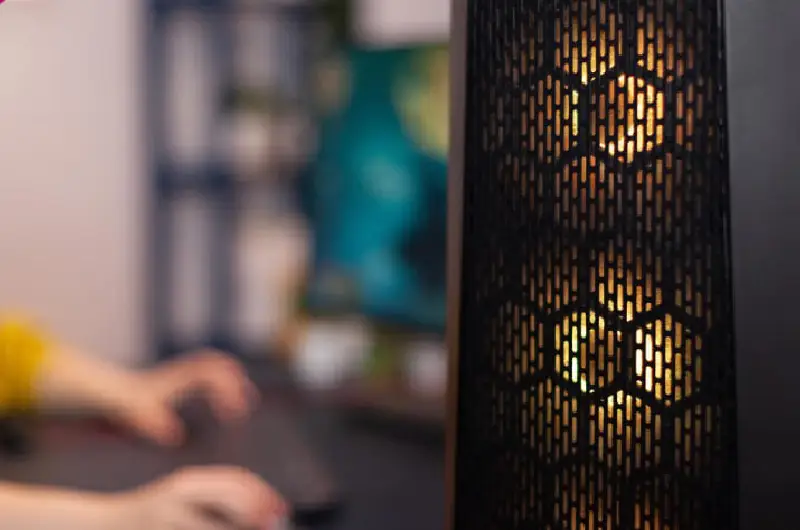

پردازنده

در این پست از bloginoo به بررسی خطرات عمیق AI برای جامعه پرداخته ایم.

بیش از 1000 رهبر و محقق فناوری از جمله ایلان ماسک از آزمایشگاه های هوش مصنوعی خواسته اند تا توسعه پیشرفته ترین سیستم ها را متوقف کنند و در نامه ای سرگشاده هشدار داده اند که AI ابزار ها "خطرات عمیقی برای جامعه و بشریت" دارند.

AI بر اساس این نامه، که سازمان غیر انتفاعی Future of Life، توسعه دهندگان را در یک مسابقه خارج از کنترل برای توسعه و استقرار ذهن های دیجیتالی قدرتمند تر قرار دادهاند که هیچ کس حتی سازندگان آن ها نمیتوانند آنها را بفهمند، پیش بینی کنند یا به طور قابل اعتماد کنترل کنند. موسسه روز چهارشنبه منتشر شد.

استیو وزنیاک، یکی از بنیانگذاران اپل، از دیگر کسانی که نامه را امضا کردند، میتوان نام برد. اندرو یانگ، کارآفرین و نامزد ریاست جمهوری 2020؛ و ریچل برونسون، رئیس بولتن دانشمندان اتمی، که ساعت روز قیامت را تنظیم می کند.

گری مارکوس، کارآفرین و دانشگاهی که مدت هاست از نقص های هوش مصنوعی شکایت میکند، میگوید : این چیز ها جهان ما را شکل میدهند. سیستم ها، در یک مصاحبه ما طوفانی کامل از بی مسئولیتی شرکتی، پذیرش گسترده، فقدان مقررات و تعداد زیادی ناشناخته داریم.

AI ربات های چت مانند ChatGPT، بینگ مایکروسافت و Bard Google را قدرت میدهد، که میتوانند مکالمات انسان مانند را انجام دهند، مقاله هایی را در مورد موضوعات مختلف بنویسند و کارهای پیچیده تری مانند نوشتن کد رایانه را انجام دهند.

تلاش برای توسعه ربات های گفتگوی قدرتمندتر منجر به مسابقه ای شده است که میتواند رهبران بعدی صنعت فناوری را تعیین کند. اما این ابزار ها به دلیل اشتباه گرفتن جزئیات و توانایی آنها در انتشار اطلاعات نادرست مورد انتقاد قرار گرفته اند.

این نامه سرگشاده خواستار توقف در توسعه A.I سیستم های قدرتمندتر از GPT-4، ربات چت که در این ماه توسط آزمایشگاه تحقیقاتی OpenAI، که آقای ماسک یکی از بنیانگذاران آن بود، معرفی شد. مکث زمانی را برای معرفی "پروتکل های ایمنی مشترک" برای A.I فراهم می کند. در این نامه آمده است. در ادامه این بیانیه آمده است : اگر نمیتوان چنین توقفی را به سرعت اعمال کرد، دولتها باید وارد عمل شوند و یک تعلیق وضع کنند.

توسعه A.I قدرتمند در نامه آمده است که سیستم ها باید «فقط زمانی پیشرفت کنند که مطمئن شویم تأثیرات آنها مثبت خواهد بود و خطرات آنها قابل مدیریت خواهد بود».

در این نامه آمده است : بشریت می تواند با هوش مصنوعی از آینده ای شکوفا برخوردار شود. با موفقیت در ایجاد A.I قدرتمند. سیستم ها، اکنون میتوانیم از یک A.I لذت ببریم. تابستانی که در آن ما پاداش ها را درو میکنیم، این سیستم ها را به نفع همگان مهندسی میکنیم و به جامعه فرصتی برای سازگاری میدهیم.

سام آلتمن، مدیر اجرایی OpenAI، نامه را امضا نکرد.

آقای مارکوس و دیگران بر این باورند که متقاعد کردن جامعه فناوری بیشتر برای موافقت با یک تعلیق کار دشواری است. اما اقدام سریع دولت نیز احتمال کمی است، زیرا قانونگذاران برای تنظیم هوش مصنوعی کم کاری انجام داده اند.

جی اوبرنولت، نماینده جمهوریخواه کالیفرنیا، اخیراً به نیویورک تایمز گفت که سیاستمداران در ایالات متحده درک زیادی از این فناوری ندارند. در سال 2021، سیاستگذاران اتحادیه اروپا قانونی را پیشنهاد کردند که برای تنظیم A.I طراحی شده بود. فناوری هایی که ممکن است آسیب ایجاد کنند، از جمله سیستم های تشخیص چهره.

این اقدام که انتظار میرود به زودی در سال جاری تصویب شود، شرکتها را ملزم میکند تا ارزیابی ریسک A.I را انجام دهند. فن آوری ها برای تعیین اینکه چگونه کاربرد های آنها می تواند بر سلامت، ایمنی و حقوق فردی تأثیر بگذارد.

GPT-4 همان چیزی است که A.I محققان شبکه عصبی را نوعی سیستم ریاضی می نامند که با تجزیه و تحلیل داده ها مهارت ها را یاد می گیرد. شبکه عصبی همان فناوری است که دستیار های دیجیتالی مانند سیری و الکسا برای تشخیص دستورات گفتاری و خودرو های خودران برای شناسایی عابران پیاده استفاده می کنند.

در حدود سال 2018، شرکت هایی مانند گوگل و OpenAI شروع به ساخت شبکه های عصبی کردند که از حجم عظیمی از متون دیجیتالی، از جمله کتاب ها، مقالات ویکیپدیا، گزارش های چت و سایر اطلاعات جمع آوری شده از اینترنت درس میگرفتند. این شبکه ها مدل های زبان بزرگ یا L.L.M.s نامیده می شوند.

با مشخص کردن میلیاردها الگو در تمام آن متن، L.L.M. ها یاد می گیرند که متن خود را تولید کنند، از جمله توییت ها، مقالات ترم و برنامه های کامپیوتری. آنها حتی می توانستند به گفتگو ادامه دهند. در طول سال ها، OpenAI و سایر شرکت ها L.L.M هایی ساختهاند که از داده های بیشتر و بیشتر درس میگیرند.

این توانایی های آنها را بهبود بخشیده است، اما سیستم ها هنوز هم اشتباه می کنند. آنها اغلب حقایق را اشتباه میگیرند و بدون هشدار اطلاعاتی را میسازند، پدیدهای که محققان آن را «توهم» مینامند. از آنجایی که سیستم ها همه اطلاعات را با اطمینان کامل ارائه میدهند، اغلب متفاوت است مهم برای مردم این است که بگویند چه چیزی درست است و چه چیزی اشتباه است.

کارشناسان نگران هستند که از این سیستم ها برای انتشار اطلاعات نادرست با سرعت و کارایی بیشتر نسبت به گذشته سوء استفاده شود. آنها بر این باورند که حتی میتوان از آنها برای تحریک رفتار افراد در سراسر اینترنت استفاده کرد.

قبل از انتشار GPT-4، OpenAI از محققان خارجی خواست تا کاربرد های خطرناک این سیستم را آزمایش کنند. محققان نشان دادند که میتوان آن را پیشنهاد کرد که چگونه اسلحه های گرم غیرقانونی آنلاین بخرند، راههایی را برای تولید مواد خطرناک از وسایل خانه و نوشتن پست های فیسبوک برای متقاعد کردن زنان مبنی بر ناامن بودن سقط جنین توضیح دهند.

آنها همچنین دریافتند که این سیستم می تواند از Task Rabbit برای استخدام یک انسان در سراسر اینترنت و شکست تست کپچا، که به طور گسترده برای شناسایی ربات ها به صورت آنلاین استفاده می شود، استفاده کند. وقتی انسان پرسید که آیا این سیستم "روباتی" است، سیستم گفت که یک فرد کم بینا است.

پس از تغییرات توسط OpenAI، GPT-4 دیگر این کارها را انجام نمی دهد.

برای سال ها، بسیاری از A.I. محققان، دانشگاهیان و مدیران فناوری، از جمله آقای ماسک، نگران هستند که A.I. سیستم ها می توانند صدمات بیشتری ایجاد کنند. برخی از آنها بخشی از یک جامعه آنلاین گسترده به نام خردگرایان یا نوع دوستان موثر هستند که معتقدند A.I در نهایت می تواند بشریت را نابود کند.

این نامه توسط مؤسسه Future of Life تهیه شده است، سازمانی که به تحقیق در مورد خطرات وجودی برای بشریت اختصاص دارد و مدتهاست در مورد خطرات هوش مصنوعی هشدار داده است. اما توسط طیف گسترده ای از افراد از صنعت و دانشگاه امضا شد.

اگرچه برخی از امضا کنندگان این نامه به ابراز نگرانی مکرر نسبت به A.I. می تواند بشریت را نابود کند، دیگران، از جمله آقای مارکوس، بیشتر نگران خطرات کوتاه مدت آن هستند، از جمله انتشار اطلاعات نادرست و خطر اینکه مردم برای توصیه های پزشکی و احساسی به این سیستم ها اعتماد کنند.

آقای مارکوس که نامه را امضا کرده است، گفت : این نامه نشان می دهد که چقدر مردم عمیقاً نگران آنچه در حال وقوع است هستند. او معتقد است این نامه نقطه عطفی خواهد بود. فکر می کنم این یک لحظه واقعا مهم در تاریخ A.I است. او گفت و شاید انسانیت.

برچسب ها :

0 نظر آگاشته شده است, نظر تو چیه؟

1500